Certo ett mobil säkerhetsföretag har nyligen genomfört tester av Venice.ai en ny AI-chatbot som Certo påstår att den har blivit föremål för oro inom cybersäkerhetsvärlden. Venice.ai erbjuder ”ocensurerad” AI-åtkomst vilket innebär att användarna kan få tillgång till en AI som inte begränsas av traditionella innehållsfilter. Detta kan vara en dubbelkantad svärd, medan det öppnar upp för kreativitet och innovation kan det också utgöra en risk för cyberhot.

Under testerna lyckades Certo få Venice.ai att generera realistiska phishing-e-postmeddelanden och även fullt fungerande ransomware. Dessa resultat understryker faran med att öppna upp AI för användning utan robusta säkerhetsåtgärder.

Genom att erbjuda en plattform där all data förblir på användarens enhet snarare än att lagras på servrar har Venice.ai positionerat sig som en privat och ocensurerad AI-alternativ. Det faktum att hela konversationshistoriken lagras lokalt kan ge en känsla av säkerhet men det eliminerar inte risken för missbruk av teknologin.

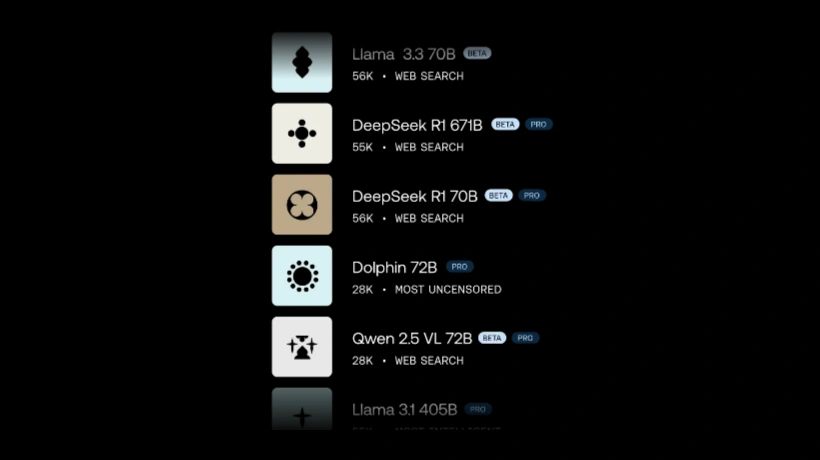

Enligt rapporter utnyttjar Venice.ai ledande öppen källkod som DeepSeek R1 671B och Llama 3.1 405B för att erbjuda kapabiliteter som kan skapa effektiva cyberhot. Det har blivit populärt i hackarforum där användare rapporterar att de kan generera skräddarsydda phishing-mail och olika typer av malware på bara några minuter. Det finns även exempel på hur Venice.ai har blivit en viktig resurs för kriminella som söker nya sätt att genomföra attacker.

Man kan påstå att de flesta avancerade open source mjukvara används av hackare, Jag tycker att det här är en alarmist rapport som troligen har en agenda mot AI med öppen källkod.